-

CENTRES

Progammes & Centres

Location

इसमें कोई शक नहीं कि आर्टिफिशियल इंटेलिजेंस में मानवीय विशेषताएं डालने से लोगों को एआई के इस्तेमाल में आसानी होगी. इस पर भरोसा भी बढ़ेगा लेकिन इसके साथ ही ये भी हकीकत है कि ऐसा होने पर एआई से लोगों की उम्मीदें बहुत ज्यादा बढ़ जाएंगी. इसे लेकर नैतिक संकट और कानूनी चुनौतियां भी बढ़ेंगी.

एआई के व्यापक प्रचार-प्रसार के साथ ही एंथ्रोपमॉर्फाइज़ेशन को लेकर गंभीर चर्चा तेज़ हो गई है. एंथ्रोपमॉर्फाइज़ेशन यानी मानवीय विशेषताओं को आर्टिफिशियल इंटेलिजेंस में डालना. लेकिन इसके दुष्परिणाम भी दिख सकते हैं. इससे लोगों को गुमराह किया जा सकता है. नैतिकता और निजता सम्बंधी खतरे भी खड़े हो सकते हैं.

एंथ्रोपमॉर्फाइज़ेशन को फिल्मों में बहुत ही नाटकीय तरीके से दिखाया जाता है. फिल्म टर्मिनेटर इसका सबसे बड़ा उदाहरण है. इसके अलावा कई और फिल्मों और टीवी सीरियल्स में स्मार्ट वॉयस में भी इसका इस्तेमाल किया जाता है.

एंथ्रोपमॉर्फाइज़ेशन को फिल्मों में बहुत ही नाटकीय तरीके से दिखाया जाता है. फिल्म टर्मिनेटर इसका सबसे बड़ा उदाहरण है. इसके अलावा कई और फिल्मों और टीवी सीरियल्स में स्मार्ट वॉयस में भी इसका इस्तेमाल किया जाता है. जापान की एस्ट्रोबॉय सीरीज़ में भी एआई का प्रयोग किया गया है. हालांकि, एआई का ज्य़ादा इस्तेमाल उत्तरी अमेरिका के सांस्कृतिक मिज़ाज में दिखता है. यहां रोबोट बनाने के दौरान भी इस चीज़ का ख्य़ाल रखा जाता है और वहां इसे स्वीकार्यता भी हासिल है. अमेरिका में सामाजिक सुरक्षा क्षेत्र में और जापान में बुजुर्गों के लिए जो नर्सिंग होम्स होते हैं, वहां इस्तेमाल किए जाने वाले रोबोट्स में भी मानवीय गुण डाले जाते हैं

अगर हम इन सब चीजों का ध्यान रखें, तभी हम एंथ्रोपमॉर्फाइज़ेशन को उस तरह विकसित कर पाएंगे जिससे ये मौजूदा समाज की सांस्कृतिक इच्छाओं, उनके मूल्यों और स्थानीय परम्पराओं के मुताबिक ढल सकेंगे. इसे लेकर जो डर, जो आकांक्षाएं हैं. उन्हें दूर किया जा सकेगा. ये बात गौर करने लायक है कि एंथ्रोपमॉर्फाइज़ेशन का असर सिर्फ एआई के इस्तेमाल के दौरान ही महसूस नहीं होता बल्कि इसका असर एआई की डिजाइनिंग, मार्केटिंग और सामाजिक संरचना में इसे शामिल करने के दौरान भी होता है. एआई को मानवीय गुणों से युक्त देखने की हमारी ख्वाहिश हमें इसे लेकर अवास्तविक उम्मीदों, नैतिक संकट और कानूनी चुनौतियों की तरफ ले जाती है.

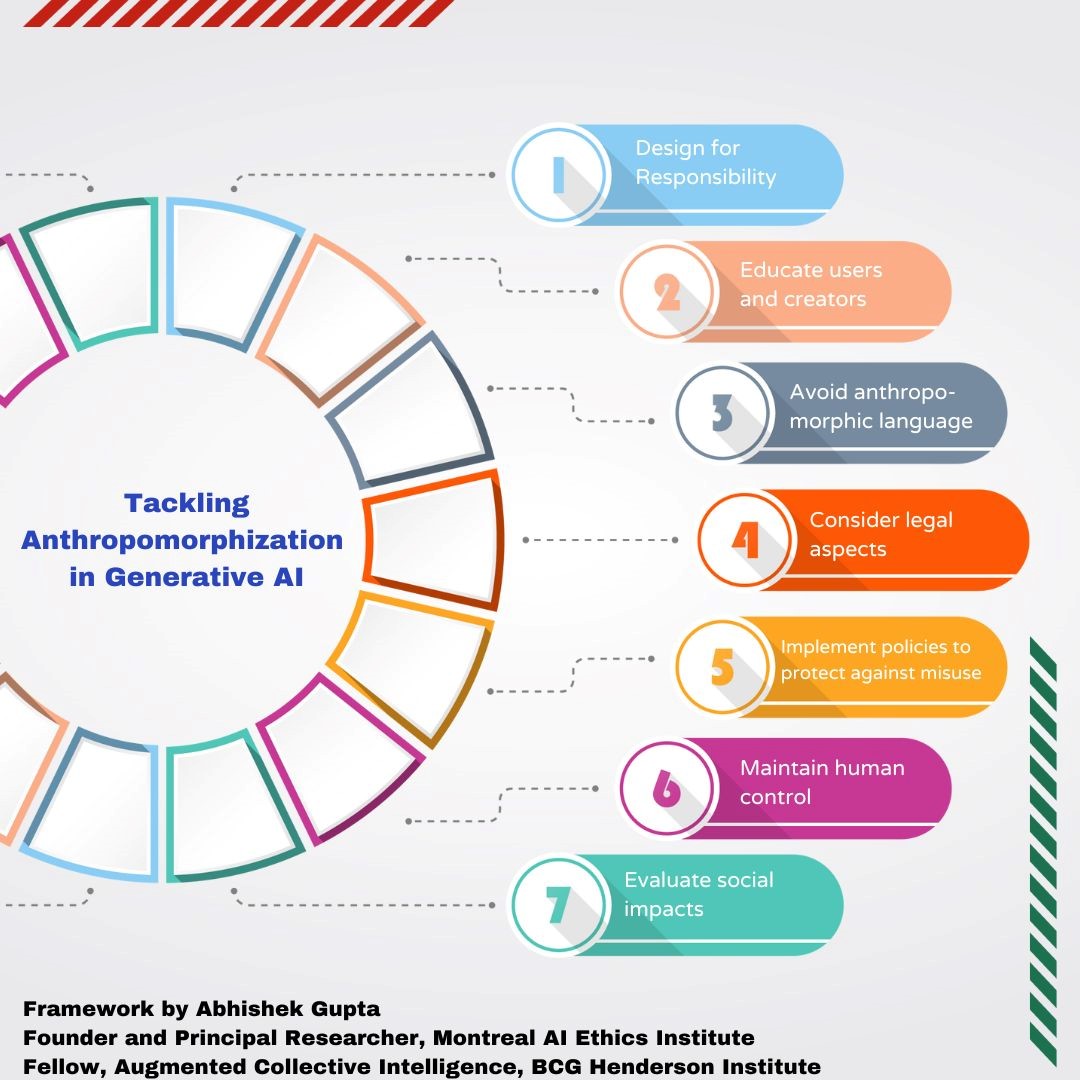

इन चुनौतियों से निपटने के लिए इन सात बिंदुओं पर ध्यान देने की जरूरत है.

एंथ्रोपोमोर्फाइजेशन द्वारा पैदा हुई चुनौतियों के सामाजिक और तकनीक़ी पहलुओं से निपटने के लिए, यह लेख एक ऐसी रूपरेखा सामने रखता है जिसमें 7 स्तंभ शामिल हैंः

1- जवाबदेही के साथ डिजाइन करना: एआई को डिज़ाइन करते वक्त ही इसके संभावित खतरों की पहचान की जाए और उनका रिकॉर्ड रखा जाए, जिससे इसके अध्ययन में मदद मिले. डिजाइनिंग की प्रक्रिया के दौरान ही एंथ्रोपमॉर्फाइज़ेशन के प्रभावों पर भी विचार किया जाना चाहिए

2- रचयिताओं और उपयोग करने वालों शिक्षित करना: एआई का इस्तेमाल करने वालों और इसे बनाने वालों को भी एंथ्रोपमॉर्फाइज़ेशन के संभावित दुष्परिणामों के बारे में सही जानकारी देनी ज़रूरी है.

3- एंथ्रोपमॉर्फाइज़ेशन भाषा से बचें: एआई और रोबोटिक प्रणाली के बारे में बताते हुए ऐसे शब्दों का इस्तेमाल किया जाना चाहिए. जिससे इसको लेकर झूठी उम्मीदें और इसकी क्षमताओं के बारे में गलत धारणाएं ना बनें.

4- कानूनी पहलुओं का ध्यान रखें: एंथ्रोपमॉर्फाइज़ेशन के इस्तेमाल से पहले इन बातों का ध्यान रखना बहुत ज़रूरी है कि इसे लेकर मौजूदा कानून और नियम-कायदे क्या कहते हैं.

5- दुरूपयोग रोकने वाली नीतियां लागू करें: नीतियां इस तरह बनाई जानी चाहिए कि एंथ्रोपमॉर्फाइज़ेशन का दुरुपयोग ना हो. भ्रामक दावे और अनुचित तरीकों का इस्तेमाल नहीं किए जाने चाहिए.

6- मानवीय नियंत्रण रहे बरकरार: एआई को विकसित करते वक्त इस बात का ध्यान रखना चाहिए कि ये प्रणाली इंसान की मदद करने के लिए है. खुद ही इंसान की तरह सोचकर काम करने के लिए नहीं. इसलिए ये ध्यान रखना ज़रूरी है कि इस पर मानवीय नियंत्रण रहे.

7- सामाजिक प्रभावों का मूल्यांकन: एआई से समाज पर पड़ने वाले संभावित असर का गंभीरता से मूल्यांकन किया जाना चाहिए. इसमें एंथ्रोपमॉर्फाइज़ेशन से होने वाले परिणाम भी शामिल हैं.

एआई को विकसित करने से पहले वास्तविक दुनिया में इसके असर को समझने के लिए अगर इन सात अहम बिंदुओं पर विचार किया जाएगा तो इसके बेहतर नतीजे आएंगे.

हाल के दिनों में कलाकारों और चित्रकारों ने एडोब कंपनी के एआई मॉडल्स को लेकर चिंताएं जताई हैं. इन एआई मॉडल्स की मदद से किसी भी कलाकार या चित्रकार के काम में बदलाव किए जा सकते हैं, उसे नए तरीके से पेश किया जा सकता है और इसके लिए इन कलाकारों की अनुमति लेनी भी जरूरी नहीं है. इससे उन कलाकारों के काम की निजी पहचान प्रभावित होती हैं, फिर भी इसे कॉपीराइट का उल्लंघन नहीं माना जाता. अगर इसकी तुलना गूगल के एआई से करें तो वो अपने एआई मॉडल्स विकसित करने से पहले आचार संहिता का पूरी तरह पालन करता है. गूगल में एआई टूल को डिजाइन करने से पहले ही इस बात की समीक्षा की जाती है कि इससे कोई नैतिकता संधी संकट तो खड़ा नहीं होगा. इसी प्रक्रिया को जवाबदेही के साथ डिजाइन करना कहा जाता है. इस प्रक्रिया के पालन करने के दूरगामी नतीजे काफी बेहतर होते हैं.

गूगल में एआई टूल को डिजाइन करने से पहले ही इस बात की समीक्षा की जाती है कि इससे कोई नैतिकता संधी संकट तो खड़ा नहीं होगा. इसी प्रक्रिया को जवाबदेही के साथ डिजाइन करना कहा जाता है. इस प्रक्रिया के पालन करने के दूरगामी नतीजे काफी बेहतर होते हैं.

एआई की हमारे जीवन के हर क्षेत्र में पैठ बढ़ती जा रही है. स्वास्थ्य के क्षेत्र की ही बात करें तो कई मरीज अपनी संवेदनशील जानकारियां एआई के साथ साझा करते हैं, जबकि उन्हें इसके असर की पूरी जानकारी नहीं होता. इससे उनकी निजता को नुकसान तो होता ही है साथ ही अगर एआई ने कुछ गलत हिसाब लगा लिया तो इससे मरीज की सेहत पर भी बुरा असर पड़ सकता है. इसकी तुलना अगर ओपन एआई, चैट जीपीटी से करें तो ये ज्य़ादा सुरक्षित और कम पक्षपाती है. इन्होंने अपने एआई इस तरह बनाए हैं कि ये कलाकारों को उनकी कला संरक्षित रखने में तो मदद करते ही हैं साथ ही इसे इस्तेमाल करने वालों को इसके दुष्परिणामों के बारे में भी बताते हैं.

हो सकता है हम में से कई लोग ये चाहते हों कि एआई हमारे साथ एक इंसान की तरह बर्ताव करे लेकिन हमारी उम्मीद और एआई की असली क्षमता के बीच असंतुलन की वजह से समस्याएं खड़ी हो सकती हैं. उदाहरण के तौर पर चैटबॉट जैसे एआई अपनी क्षमताओं को लेकर आपको भ्रम में डाल देते हैं. वहीं रिटेल इंडस्ट्री में काम आने वाले एआई उपभोक्ताओं की निजी पसंद-नापसंद को लेकर सटीक जानकारी देते हैं. इन एआई प्रणालियों में जो भाषा इस्तेमाल की जाती है, उनका चुनाव इस तरह से किया जाता है कि उनकी क्षमताओं को लेकर किसी तरह की झूठी उम्मीदें ना पैदा हों. इस तरह के एआई विकसित करने वाली कंपनियों को उनके निवेश के बेहतर नतीजे मिलते हैं.

इस वक्त पूरी दुनिया में चर्चा हो रही है कि एआई को लेकर नए कानून और गाइडलाइंस आनी चाहिए, जिससे ये तय हो कि एआई को कैसे विकसित और स्थापित किया जाए..खासकर इसे लेकर कानून लाने पर ज़ोर दिया जा रहा है. यही वजह कि अगर वित्तीय क्षेत्र में एआई के इस्तेमाल की बात करें तो बीबीवीए जैसे बैंक अभी भी इसे लेकर रूढ़िवादी सोच पर चल रहे हैं. उन्हें डर है कि एआई की वजह से अगर ग्राहकों से संधित संवेदनशील जानकारी उजागर हो गई तो ये कानूनी रूप से उसे बहुत महंगा पड़ सकता है. हम ये पहले ही देख चुके हैं कि एडोब के एआई टूल्स को लेकर कॉपीराइट उल्लंघन की चिंताएं जताई जा चुकी हैं.

जब से मॉर्डन एआई सिस्टम शुरू हुआ, खासकर जब से एआई का एंथ्रोपमॉर्फाइज़ेशन शुरू किया गया है तभी से इसमें ये फीचर्स हैं कि हम एल्गोरिदम के पूर्वाग्रह, पक्षपतापूर्ण और नफरत फैलाने वाली सामग्री की पहचान कर सकें. इसलिए ये जरूरी है कि हम एआई को लेकर एक ऐसी नीति बनाए जिससे इसके दुरूपयोग का रोका जा सके. इसे लेकर सबसे अच्छा काम गूगल ने किया है. गूगल के एआई में आंकड़ों का इस तरह वर्गीकरण किया जाता है. इस तरह चयन किया जाता है कि एआई से कोई समस्या पैदा ना हो क्योंकि अगर एआई विकसित करने के इस चरण में सावधानी नहीं बरती गई तो इसके गंभीर नतीजे हो सकते हैं, खासकर तब जबकि बहुत ऊंचा दांव लगा हो. स्वास्थ्य के क्षेत्र में इस्तेमाल होने वाले एआई में अक्सर ये देखा गया है कि इन्होंने गलत आंकड़े और जानकारियां दी हैं. ऐसे में ये जरूरी है कि इस सेक्टर में एआई के इस्तेमाल पर मानवीय नियंत्रण हो जिससे मरीजों को फायदा हो और एआई के पास मौजूद जानकारियों का दुरूपयोग ना हो.

जब एंथ्रोपमॉर्फाइज़ेशन का इस्तेमाल हो तो उसके दुरूपयोग को रोकने के लिए उस पर इंसानी नियंत्रण हो क्योंकि इसका आकर्षण ऐसा है कि कई बार हम एंथ्रोपमॉर्फाइज़ेशन के नतीजों को समझे बगैर इसका इस्तेमाल करना चाहते हैं.

इन्हीं सब बातों को ध्यान में रखते हुए ये जरूरी है कि जब एंथ्रोपमॉर्फाइज़ेशन का इस्तेमाल हो तो उसके दुरूपयोग को रोकने के लिए उस पर इंसानी नियंत्रण हो क्योंकि इसका आकर्षण ऐसा है कि कई बार हम एंथ्रोपमॉर्फाइज़ेशन के नतीजों को समझे बगैर इसका इस्तेमाल करना चाहते हैं. स्वास्थ्य के क्षेत्र में एआई का काम डॉक्टरों की मदद करना है, ना कि उनका विकल्प बनना. हेल्थकेयर सेक्टर में एआई को लेकर यही नजरिया इसपर मानवीय नियंत्रण बनाए रखता है. इसी तरह वित्तीय क्षेत्र में भी एआई का काम जटिल प्रक्रियाओं को सरल और स्वचालित बनाना है लेकिन चूंकि ये तकनीक़ी अभी शुरूआती दौर में है इसलिए कई बैंकों को अभी इस पर उतना भरोसा नहीं है. खासकर ग्राहकों से जुड़े मामलों को लेकर एआई का इस्तेमाल करना बैंकों को ज़ोखिम भरा लगता है क्योंकि अभी इसमें उतना मानवीय नियंत्रण नहीं है.

यहां ये बताना भी जरूरी है कि अगर हम एंथ्रोपमॉर्फाइज़ेशन से समाज पर पड़े वाले असर का मूल्यांकन नहीं करते तो इसका मतलब ये हुआ कि हम इस तकनीक़ी के गंभीर सामाजिक प्रभाव को लेकर लापरवाही दिखा रहे हैं. रिटेल इंडस्ट्री में एआई का इस्तेमाल इस तरह किया जा रहा है कि उपभोक्ता को जो चीज खरीदनी है, वो उस सामान का वर्चुअल तरीके से अनुभव ले सकते हैं. इससे ग्राहक का खरीदारी का अनुभव भी बेहतर होता है. छोटे व्यपारियों को भी ग्राहकों को अपने साथ बनाए रखने और कारोबार की लागत कम रखने में भी मदद मिलती है. हालांकि सिर्फ बिजनेस पर फोकस करने की वजह से इसके कुछ नकारात्मक नतीजे भी दिखते हैं. एडोब जिन एआई टूल्स का इस्तेमाल करता है उसे लेकर पक्षपात और विविधता में कमी जैसी चिंताएं जताई जा चुकी हैं. यानी इन्हें बनाने से पहले इनके सामाजिक असर का अध्ययन नहीं किया गया.

अब सवाल है कि जो प्रोफेशनल लोग एआई को बनाने के काम कर रहे हैं, वो इन चुनौतियों से कैसे निपटें. इसे लेकर कुछ सुझाव दिए जा सकते हैं.

1- डिजाइनिंग के स्टेज पर ही जवाबदेह बनें: किसी भी नए एआई टूल को बनाने के शुरूआती दौर में ही उसके नैतिक और सामाजिक प्रभावों पर विचार करें. संभावित खतरों की पहचान और उनके निदान का रास्ता खोजें.

2- शिक्षित करें: एआई बनाने वाले और इसे इस्तेमाल करने वाले, दोनों ही एंथ्रोपमॉर्फाइज़ेशन की बारीकियों को खुद भी समझें और दूसरों को भी समझाएं. इसमें एआई की सीमाएं और संभावित नैतिक संकट भी शामिल हैं.

3- भाषा और संवाद: एआई की व्याख्या करने के लिए भाषा का चयन सोच-समझकर करें. एंथ्रोपमॉर्फाइज़ेशन लैंग्वेज से बचें क्योंकि इससे एआई को लेकर अवास्तविक उम्मीदें लगाई जा सकती हैं.

4- कानूनी और नियामक स्वीकृति: एआई को लेकर दुनिया के किसी भी देश में जो भी नए कानून और गाइडलाइंस बनी हैं या बन रही हैं, उसे लेकर सचेत रहें. उनका पालन करिए क्योंकि अगर इनकी सही जानकारी के बगैर कोई एआई टूल बना दिया तो बाद में कानूनी दिक्कतों का सामना करना पड़ सकता है.

5- दुरूपयोग रोकने के लिए नीति बनाइये: एआई को इस तरह विकसित करिए कि सभी नियमों का क्रियान्वयन भी हो और इसका दुरूपयोग भी ना हो सके. इस तरह की नीतियां हों कि एआई को लेकर भ्रामक दावे ना किए जाएं और इसका सही तरीके से इस्तेमाल हो.

6- मानवीय निगरानी को दें प्राथमिकता: इस बात का हमेशा ध्यान रखें कि एआई का काम इंसानों की मदद करने का है, उनकी जगह लेना नहीं. अगर इसका ध्यान रखेंगे तभी आप एआई पर सार्थक मानवीय नियंत्रण बनाए रखेंगे.

7- सामाजिक असर का आंकलन करें: एआई से समाज पर पड़ने वाले प्रभाव का नियमित तौर पर मूल्यांकन करते रहिए. इस बात का भी आंकलन करिए कि अलग-अलग जनसमूहों पर इसका क्या असर होगा ताकि इससे होने वाले किसी भी दुष्परिणाम को रोका जा सके.

अगर हम एआई की इन सब चुनौतियों से निपटने के लिए कामचलाऊ तरीके अपनाने की बजाए एक समग्र दृष्टिकोण अपनाते हैं. उसी हिसाब से नीतियां बनाते हैं तो एआई के इस्तेमाल से पैदा होने वाले खतरों को बहुत हद तक कम कर सकते हैं.

(अभिषेक गुप्ता मॉन्ट्रियल एआई एथिक्स इंस्टीट्यूट के संस्थापक और प्रधान शोधकर्ता हैं)

The views expressed above belong to the author(s). ORF research and analyses now available on Telegram! Click here to access our curated content — blogs, longforms and interviews.

Abhishek Gupta is the Director for Responsible AI with the Boston Consulting Group (BCG) where he works with BCG's Chief AI Ethics Officer to advise clients and ...

Read More +